En este artículo explicamos qué es la IA generativa, cómo funciona y damos ejemplos de aplicaciones concretas en las que las que se puede aplicar a diario.

La inteligencia artificial (IA) ha avanzado significativamente en las últimas décadas. En este contexto, la IA generativa es uno de los campos más atractivos y prometedores de esta disciplina.

La IA generativa es una tecnología que tiene el potencial de revolucionar diversas industrias, desde el entretenimiento hasta la medicina. La IA generativa no solo analiza y clasifica datos, sino que también puede crear contenido nuevo, desde texto hasta imágenes y música.

¿Qué es la IA generativa?

La IA generativa es una rama de la IA que se centra en la generación de contenido nuevo que es indistinguible del contenido creado por los seres humanos. A diferencia de las técnicas de IA tradicionales —que se limitan a reconocer patrones y a hacer predicciones basadas en datos existentes — la IA generativa puede crear datos nuevos a partir de patrones aprendidos.

Uno de los subcampos de la IA generativa más importantes en la actualidad es el de los Large Language Models (LLM), estos son una combinación de algoritmos que generan texto predictivo a partir de una gran cantidad de datos. Estos modelos de lenguaje fueron entrenados con grandes volúmenes de información. La gran diferencia respecto a lo que ya conocíamos es el crecimiento exponencial de sus capacidades: cuando entrenamos un modelo con pocos datos, sus capacidades serán limitadas, en cambio cuando el volumen de datos crece, sus capacidades también lo hacen (y mucho).

¿Cómo funciona la IA generativa?

La IA generativa generalmente se basa en modelos de deep learning (un subcampo de machine learning cuyas arquitecturas, que simulan la forma en la que aprendemos los humanos, permiten modelar y entender datos más complejos), en particular las redes neuronales generativas.

Existen diversas arquitecturas que permiten el entrenamiento y la inferencia de modelos generativos. A continuación, explicaremos dos de las más populares: Modelos de difusión y los Modelos Autorregresivos (como GPT) y otro concepto importante como lo es el de los Modelos Fundacionales.

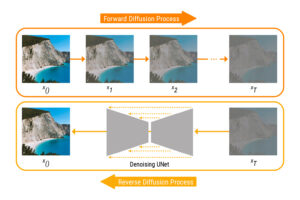

Modelos de difusión (Diffusion Models)

Los modelos de difusión son un tipo IA generativa que produce imágenes fotorrealistas únicas a partir de mensajes de texto e imagen. Un ejemplo de esto es Stable Diffusion, que se lanzó originalmente en 2022.

Además de imágenes, también se puede usar el modelo para crear videos y animaciones. Entre las cosas que pueden realizar estos modelos están: generación de texto a imagen, generación de imagen a imagen, creación de gráficos, obras de arte y logotipos, edición y retoque de imágenes, creación de video.

En este enlace se puede acceder a uno de estos modelos y probar su funcionamiento.

Funcionamiento del modelo Stable Diffusion – Fuente

Modelos Autorregresivos

Se les llama así porque funcionan prediciendo la siguiente unidad de datos basada en las unidades anteriores (por ejemplo, la siguiente palabra en una secuencia de texto). GPT (Generative Pre-trained Transformer), es un ejemplo de este tipo de modelos.

Vamos a explicarlo a partir de un ejemplo, supongamos que la entrada del modelo es: “El perro es el mejor amigo”. Basado en esa entrada, muy probablemente, la predicción para la siguiente unidad de datos (en este caso sería una palabra) sería “del” y, una vez teniendo “El perro es el mejor amigo del”, la siguiente predicción —basada en las unidades anteriores— sería “hombre” completando así la frase: “El perro es el mejor amigo del hombre”.

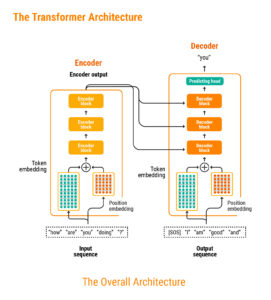

Estos modelos se entrenan en grandes conjuntos de datos y pueden generar texto coherente y contextual. El modelado autorregresivo es un componente importante de los GPT que funcionan con un tipo de arquitectura llamada Transformer que, básicamente consta de:

- Un codificador que permite la comprensión del lenguaje natural.

- Un decodificador para la generación del lenguaje natural.

Es decir, se toma una frase de entrada y esta se codifica transformándola en valores numéricos y realizando ciertas operaciones para comprender la importancia de cada una de las palabras y la relación con otras palabras de la misma frase. El decodificador toma estos números y por medio de operaciones matemáticas define cuál es la palabra a seguir para así construir una frase completa y coherente y entregarla como respuesta.

GPT usa solo el decodificador para el modelado del lenguaje autorregresivo. Esto le permite entender el lenguaje natural y responder de manera tal que las personas lo comprendan.

Arquitectura del transformer – Fuente

Un LLM basado en GPT predice la palabra siguiente teniendo en cuenta la probabilidad de distribución del corpus de texto con el que se entrena. Es decir, se destaca el flujo de información desde las palabras anteriores a la predicción de la siguiente palabra.

Modelos fundacionales (FM)

Son modelos entrenados con conjuntos de datos masivos con el fin de, en lugar de hacer desarrollos de IA desde cero, ser utilizados como un punto de partida para desarrollar (de forma rápida y rentable) modelos que cumplan tareas más específicas.

Una característica única de estos modelos es su adaptabilidad, ya que pueden desarrollar una amplia gama de tareas con un alto grado de precisión. Algunos ejemplos de estos modelos fundacionales son: Bidirectional Encoder Representations from Transformers (BERT), GPT, Claude, Stable Diffusion, Huggin Face.

¿Qué aplicaciones tiene la IA generativa?

La IA generativa tiene aplicaciones en una amplia variedad de campos. A continuación, presentamos algunas de las más destacadas:

1. Creación de contenido

La IA generativa se utiliza para crear contenido textual, como artículos, historias, y código. Modelos como GPT-4, LLAMA, Gemeni han demostrado una capacidad impresionante para generar texto coherente y relevante.

Poema generado con GPT-4 con el siguiente prompt: “escribe un poema corto relacionado con la IA generativa”.

2. Generación de imágenes y arte

Los modelos de difusión se utilizan para crear imágenes y obras de arte. Estas imágenes pueden ser realistas o completamente abstractas, dependiendo del objetivo del generador.

Imagen generada con el siguiente prompt: “pintura de un caballo, estilo de Salvador Dalí”.

3. Música y audio

La IA generativa también se aplica en la creación de música y efectos de sonido. Modelos como Jukedeck y OpenAI’s MuseNet pueden componer piezas musicales en una variedad de estilos y géneros.

4. Videojuegos y Simulaciones

En el desarrollo de videojuegos, la IA generativa puede crear escenarios, personajes y misiones. Esto permite una experiencia de juego más rica y variada. Un claro ejemplo es Scenario que permite generar paisajes, personajes y demás elementos relacionados a videojuegos.

Escenario y personajes generados con Scenario usando el siguiente prompt: “wood houses in the middle of the forest with to farmers, two characters a boy and a girl, both with swords and shields”.

Desafíos y consideraciones éticas

Aunque la IA generativa ofrece muchas posibilidades, también presenta desafíos y preocupaciones éticas. Algunos de los principales desafíos incluyen:

- Calidad y realismo: Aunque los modelos de difusión y otros modelos generativos han mejorado significativamente, a veces el contenido generado aún puede ser imperfecto o poco realista.

- Propiedad intelectual: La generación de contenido nuevo basado en datos existentes plantea preguntas sobre la propiedad y los derechos de autor.

- Uso malintencionado: La IA generativa puede ser utilizada para crear noticias falsas y contenido engañoso, lo que puede tener graves consecuencias sociales y políticas.

- Sesgo: Los modelos de IA pueden perpetuar o incluso amplificar los sesgos presentes en los datos de entrenamiento. Es crucial que las personas que trabajan en el desarrollo trabajen para identificar y mitigar estos sesgos.